Bilderkennung zählt heute zu den spannendsten Anwendungen künstlicher Intelligenz. Sie ermöglicht es Computern, Bilder ähnlich wie Menschen zu identifizieren, zu analysieren und zu interpretieren. Vom Entsperren von Smartphones per Gesichtserkennung bis zum Taggen von Fotos in sozialen Medien – Bilderkennung revolutioniert unsere Interaktion mit Technologie.

Ein Verständnis ihrer Funktionsweise kann Anfängern, Studierenden und Berufstätigen helfen, ihre praktischen Anwendungsmöglichkeiten zu entdecken und ihre technischen Fähigkeiten zu verbessern.

Dieser Leitfaden erklärt den Prozess Schritt für Schritt in einfachen Worten, verdeutlicht komplexe Konzepte und zeigt ihre praktischen Anwendungen im Alltag auf.

Wichtigste Erkenntnisse

- Bilderkennung wandelt Bilder in aussagekräftige, verwertbare Daten um.

- Neuronale Netze ermöglichen es KI, Bilder zu „sehen“ und daraus zu lernen.

- Die Datenqualität ist entscheidend für präzise Vorhersagen.

- Ethische Nutzung und Datenschutzkonformität sind unerlässlich.

- Einsteiger können Python-Bilderkennungstools und vortrainierte KI-Modelle nutzen.

Was ist Bilderkennung in der KI?

Bilderkennung in der KI bezeichnet die Fähigkeit von Software, Objekte, Personen, Tiere, Texte oder andere Merkmale in Bildern zu identifizieren. Im Gegensatz zum menschlichen Sehen, das Sinne und Intuition vereint, nutzt Bilderkennungssoftware Algorithmen des maschinellen Lernens, um Muster zu erkennen und Entscheidungen zu treffen.

Sie ist ein Teilgebiet der Computer Vision, eines umfassenderen KI-Felds, das Maschinen das „Sehen“ und Handeln auf Basis visueller Informationen ermöglichen soll.

Künstliche Intelligenz wandelt Bilder in aussagekräftige Daten um und ermöglicht so die Automatisierung von Aufgaben wie der Analyse medizinischer Scans, der Sortierung von Produkten im Einzelhandel oder der Überwachung von Sicherheitskameras.

Wichtigste Vorteile der Bilderkennung in der KI:

- Automatisiert wiederkehrende Aufgaben, die sonst menschliche Arbeitskraft erfordern würden.

- Verbessert die Genauigkeit bei der Erkennung von Objekten, Mustern oder Anomalien.

- Beschleunigt Prozesse wie die medizinische Bildanalyse oder die Produktidentifizierung.

- Unterstützt Echtzeit-Entscheidungen in Anwendungen wie autonomen Fahrzeugen.

- Steigert die Effizienz in Branchen wie Einzelhandel, Sicherheit und Gesundheitswesen.

- Liefert datengestützte Erkenntnisse für bessere Geschäfts- und Betriebsentscheidungen.

Wie Bilderkennung funktioniert – Schritt für Schritt

Neugierig darauf, wie Maschinen Bilder „sehen“ und verstehen. Wir erklären Ihnen den Prozess Schritt für Schritt, damit Sie genau sehen, wie Bilderkennung Bilder in verwertbare Erkenntnisse umwandelt.

Schritt 1: Bildeingabe und Pixeldarstellung

Jedes digitale Bild besteht aus Pixeln, winzigen Farbquadraten, die zusammen ein Bild ergeben. Für die KI-Bilderkennung wird jedes Pixel in Zahlen umgewandelt, die die Farbintensität repräsentieren, z. B. die Rot-, Grün- und Blauwerte in RGB-Bildern.

Auch Schwarz-Weiß-Bilder lassen sich numerisch darstellen. Python-Bilderkennungstools verwenden dieses Matrixformat häufig, um Bilder für die Weiterverarbeitung vorzubereiten.

Schritt 2: Bildvorverarbeitung und Normalisierung

Vor dem Training eines Modells werden Bilder vorverarbeitet, um Rauschen zu reduzieren und die Eingaben zu standardisieren. Dazu gehören die Skalierung der Bilder auf eine einheitliche Größe, die Anpassung von Helligkeit und Kontrast sowie die Normalisierung der Pixelwerte.

Die Vorverarbeitung stellt sicher, dass sich das Modell auf wesentliche Muster und nicht auf irrelevante Details konzentriert. Techniken wie Bildaugmentation, Spiegeln, Drehen oder Zuschneiden von Bildern erweitern den Datensatz und verbessern so die Modellleistung und Robustheit in realen Szenarien.

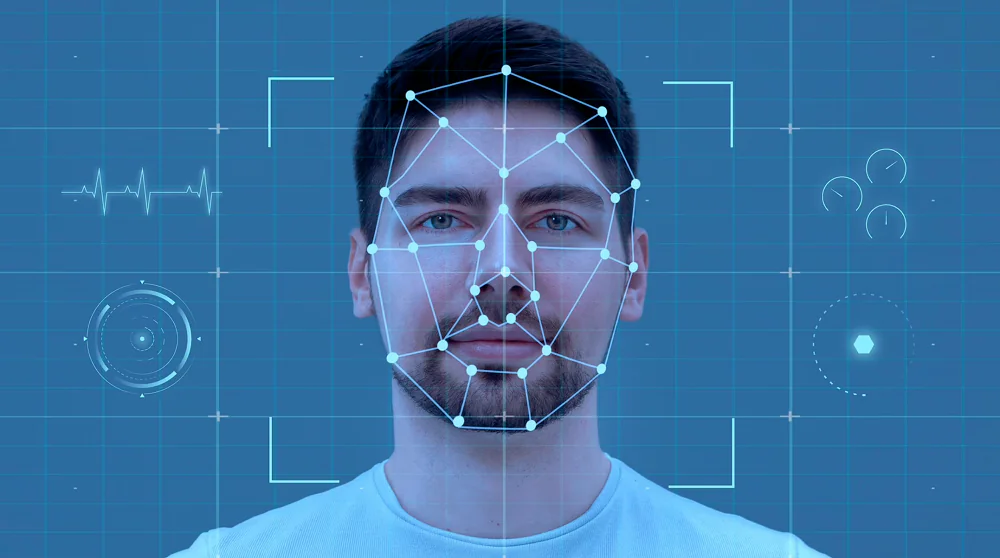

Schritt 3: Merkmalsextraktion mithilfe neuronaler Netze

Die Merkmalsextraktion ist der Prozess der Identifizierung von Kanten, Formen, Texturen und Mustern in einem Bild. Sehr tiefe Faltungsnetzwerke für die großflächige Bilderkennung sind speziell darauf ausgelegt, diese hierarchischen Merkmale zu erfassen. Faltungsnetzwerke (CNNs) scannen Bilder mithilfe von Filtern und erkennen dabei kleine Details in den ersten Schichten und komplexere Strukturen in tieferen Schichten.

Schritt 4: Mustererkennung und Klassifizierung

Nach der Merkmalsextraktion lernt das KI-Modell, diese Muster bestimmten Kategorien zuzuordnen. Beispielsweise könnte ein Modell lernen, dass runde Formen mit bestimmten Texturen wahrscheinlich Orangen sind. Deep Residual Learning für die Bilderkennung hilft Modellen, komplexe Muster zu lernen, ohne dass die Genauigkeit mit zunehmender Anzahl an Schichten abnimmt.

Während des Trainings passt das Modell die Gewichte an, um Fehler zu minimieren und so seine Vorhersagefähigkeit zu verbessern.

Schritt 5: Modellausgabe und Entscheidungsfindung

Nach dem Training kann das Modell vorhersagen, was neue Bilder darstellen. Es weist seinen Vorhersagen Konfidenzwerte zu, sodass Entwickler verstehen können, wie sicher sich die KI ihrer Ergebnisse ist.

Die Modellausgabe kann Entscheidungen in der medizinischen Diagnostik, bei Empfehlungen im Einzelhandel oder bei Sicherheitswarnungen beeinflussen und demonstriert so den praktischen Nutzen der KI-Bilderkennung.

Die Rolle neuronaler Netze in der Bilderkennung

Im Folgenden werden einige wichtige Regeln der Bilderkennung erläutert, die die Bedeutung neuronaler Netze für die Analyse und das Verständnis visueller Daten verdeutlichen:

- Neuronale Netze ahmen das Informationsverarbeitungssystem des menschlichen Gehirns nach.

- Sie bestehen aus mehreren Schichten mit miteinander verbundenen Knoten.

- Jede Schicht analysiert und verfeinert Muster in den Bilddaten.

- Dieser geschichtete Ansatz hilft Modellen, komplexe und feine visuelle Details zu verstehen.

- In der KI-Bilderkennung können neuronale Netze neue, unbekannte Bilder erkennen, indem sie aus Trainingsdaten lernen.

- Deep-Learning-Modelle verarbeiten dank ihrer Generalisierungsfähigkeit verschiedene Bildszenarien präzise.

- Fortgeschrittene Architekturen wie ResNet und DenseNet lernen robuste Repräsentationen visueller Daten.

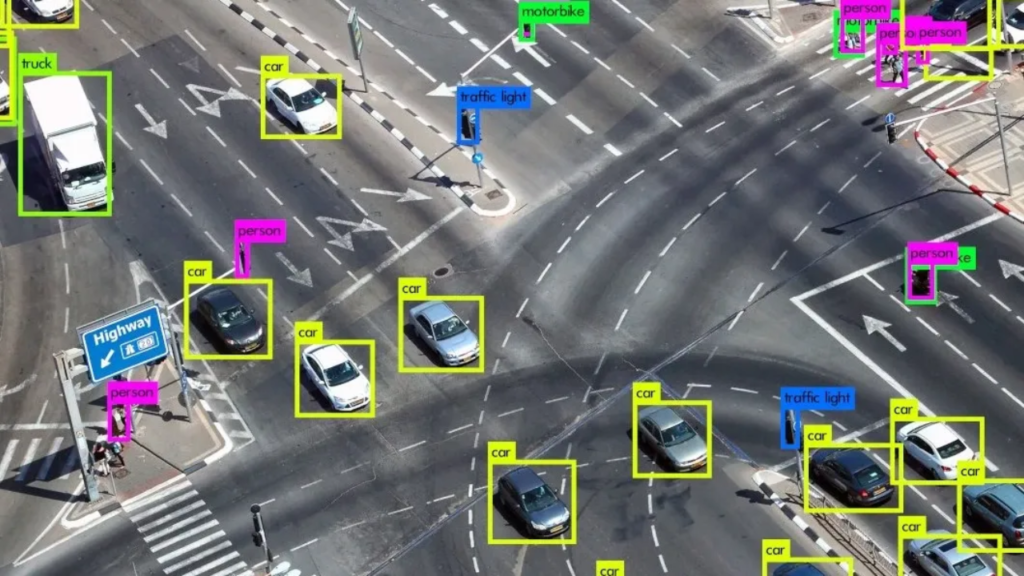

Bilderkennung vs. Bildklassifizierung vs. Objekterkennung

| Technik | Zweck | Ausgabe Beispiel |

| Bilderkennung | Identifiziert, was ein gesamtes Bild darstellt | Straßenszene, Porträt, Landschaft |

| Bildklassifikation | Weist dem Hauptobjekt im Bild ein Label zu | „Hund“, „Auto“, „Baum“ |

| Objekterkennung | Erkennt und lokalisiert mehrere Objekte in einem Bild | Begrenzungsrahmen um Autos, Personen und Schilder |

| Bildsegmentierung | Klassifiziert jedes Pixel für eine präzise Objektidentifikation | Pixelgenaue Zuordnung von Hund, Straße oder Gebäude |

Training eines Bilderkennungsmodells

Ein Bilderkennungsmodell so zu trainieren, dass es Objekte präzise identifiziert, mag komplex erscheinen, aber mit den richtigen Schritten können selbst Anfänger beeindruckende Ergebnisse erzielen.

Datenerfassung und Datensatzqualität

Hochwertige Datensätze sind entscheidend für die Modellgenauigkeit. Datensätze wie ImageNet liefern Millionen von annotierten Bildern für das Training.

Die Vielfalt der Bilder gewährleistet, dass das Modell Muster lernt, die auf verschiedene reale Szenarien anwendbar sind.

Bildannotation und -kennzeichnung

Die präzise Kennzeichnung von Bildern, sei es mithilfe von Begrenzungsrahmen, Tags oder Segmentierungsmasken, ist unerlässlich. Die manuelle Überprüfung reduziert Fehler und stellt sicher, dass Modelle korrekte Zuordnungen zwischen Merkmalen und Kennzeichnungen lernen.

Modelltraining und -evaluierung

Das Training umfasst das Einspeisen annotierter Bilder in das neuronale Netzwerk und die Anpassung der Modellgewichte anhand der Vorhersagefehler. Die Evaluierung anhand von Testdatensätzen misst Genauigkeit und Generalisierung und verhindert Überanpassung.

Python-Tools zur Bilderkennung bieten häufig vortrainierte Modelle für Anfänger an, um diesen Prozess zu beschleunigen und gleichzeitig robuste Ergebnisse zu gewährleisten.

Beliebte Bilderkennungsmodelle für Einsteiger

Für Einsteiger in die Bilderkennung ist es hilfreich, die gängigsten Modelle und Werkzeuge zu kennen. Diese Modelle unterscheiden sich in Komplexität, Geschwindigkeit und Genauigkeit und bieten Ihnen je nach Projekt verschiedene Optionen:

- Convolutional Neural Networks (CNNs): Ideal zum Extrahieren von Mustern, Kanten und Formen aus Bildern und bilden die Grundlage der meisten Bilderkennungsaufgaben.

- ResNet (Deep Residual Learning for Image Recognition): nutzt Residualverbindungen, um sehr tiefe Netzwerke effizient zu trainieren und die Genauigkeit bei komplexen Datensätzen zu verbessern.

- YOLO (You Only Look Once): Ein Echtzeit-Objekterkennungsmodell, das Objekte in Bildern schnell identifiziert und klassifiziert.

- Very Deep Convolutional Networks for Large-Scale Image Recognition: entwickelt für die Verarbeitung massiver Datensätze und komplexer Muster, geeignet für umfangreiche Bilderkennungsanwendungen.

- Vision Transformers (ViT): Eine moderne Alternative, die Aufmerksamkeitsmechanismen nutzt, um große Bilder mit hoher Genauigkeit zu verarbeiten.

- KI-Bilderkennungstools: Anfänger können mit Python-Bilderkennungsbibliotheken oder Google-Bilderkennungs-APIs praktisch experimentieren, um diese Modelle zu implementieren und zu testen.

Anwendungsbeispiele für Bilderkennung in der Praxis

Bilderkennung ist in vielen Branchen etabliert. Im Gesundheitswesen unterstützt sie die Analyse medizinischer Bilder zur Früherkennung. Einzelhändler nutzen die visuelle Suche, um Kunden die Produktsuche anhand von Bildern zu ermöglichen.

Autonome Fahrzeuge setzen KI-gestützte Bilderkennung ein, um Fußgänger und Verkehrszeichen zu erkennen. Soziale Medien verwenden Bilderkennungssoftware, um Fotos automatisch zu taggen.

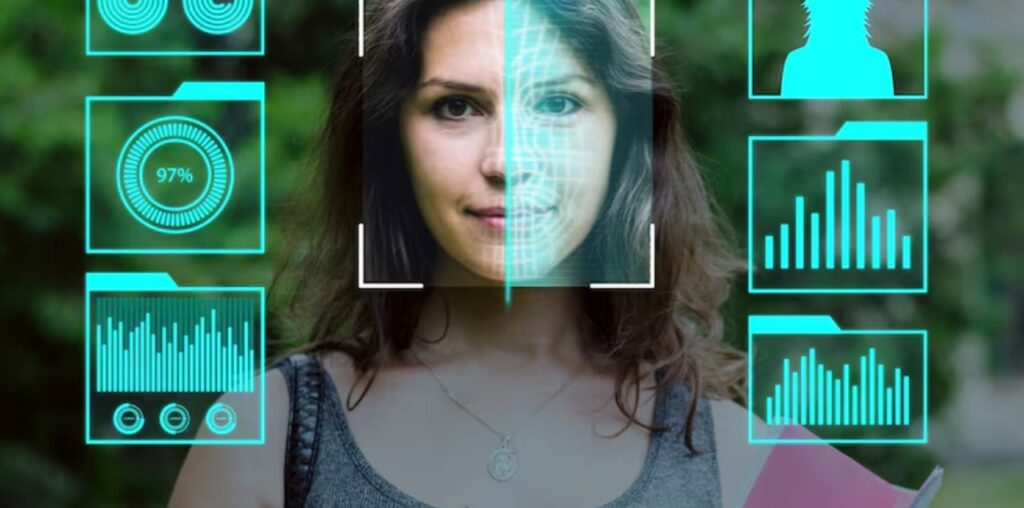

Im Sicherheitsbereich hilft die Gesichtserkennung bei der Zugangskontrolle zu sensiblen Bereichen. In der Konsumgüterindustrie unterstützt die Bilderkennung die effiziente Überwachung von Produktplatzierung und Lagerbeständen.

Grenzen und Herausforderungen der Bilderkennung

Trotz ihrer rasanten Fortschritte steht die Bilderkennung nach wie vor vor einigen wichtigen Herausforderungen, die Anfänger und Anwender kennen sollten:

- Datenqualität und -quantität: Modelle benötigen große, präzise annotierte Datensätze; unzureichende oder mangelhafte Daten verringern die Genauigkeit.

- Adversarial Attacks: Kleine, oft unmerkliche Bildveränderungen können KI-Modelle dazu verleiten, Objekte falsch zu klassifizieren.

- Kontextverständnis: Modelle können Objekte in ungewöhnlichen oder komplexen Umgebungen falsch interpretieren.

- Verzerrungen in Datensätzen: Ungleichmäßige oder verzerrte Daten können zu unfairen Vorhersagen und systematischen Fehlern führen.

- Datenschutzbedenken: Das Sammeln und Verwenden von Bildern wirft ethische und rechtliche Fragen hinsichtlich personenbezogener Daten auf.

- Ressourcenintensität: Das Training großer Modelle erfordert erhebliche Rechenleistung und Zeit.

- Generalisierungseinschränkungen: Modelle können Schwierigkeiten mit neuen oder unbekannten Bildtypen außerhalb ihrer Trainingsdaten haben.

Ethische, datenschutzrechtliche und rechtliche Bedenken

Der verantwortungsvolle Einsatz von Bilderkennung ist unerlässlich. Gesichtserkennung und Überwachung können Datenschutzrisiken bergen. Unternehmen müssen Datenschutzbestimmungen einhalten, die Einwilligung der Nutzer einholen und Verzerrungen in KI-Modellen vermeiden.

Transparenz und ethischer Einsatz von Bilderkennungssoftware stärken das Vertrauen der Öffentlichkeit und gewährleisten gleichzeitig die Einhaltung gesetzlicher Bestimmungen.

Fazit

Bilderkennung ist eine leistungsstarke Technologie, die visuelle Informationen in verwertbare Daten umwandelt. Durch das Erlernen von Mustern in Pixeln mithilfe neuronaler Netze können KI-Systeme Objekte identifizieren, Bilder klassifizieren und Anwendungen in verschiedenen Branchen unterstützen.

Anfänger können mit Python-Bilderkennungstools oder vortrainierten KI-Modellen in dieses Gebiet einsteigen. Bei sorgfältiger Beachtung der Datenqualität, des Modelltrainings und der ethischen Anwendung bietet die Bilderkennung unzählige Möglichkeiten für Innovation und Problemlösung.

FAQs

ChatGPT kann Bilder nicht direkt erkennen, aber es kann Bilderkennungstechniken und -werkzeuge beschreiben, analysieren und Nutzern Anleitungen dazu geben.

Maschinelles Lernen eignet sich für kleinere Datensätze und einfachere Muster; Deep Learning erzielt bei großen, komplexen Bilddatensätzen eine höhere Genauigkeit.

Die vier gängigen Bildtypen sind Raster-, Vektor-, Bitmap- und Fotobilder. Jeder Typ hat seine spezifischen Anwendungsbereiche und Auflösungen.

JPEG eignet sich am besten für Fotos mit geringer Dateigröße, PNG für Transparenz, BMP für einfache Darstellung und TIFF für hochwertige Drucke.

Die zwei Haupttypen sind Rasterbilder, die aus Pixeln bestehen, und Vektorgrafiken, die mit skalierbaren mathematischen Formen erstellt werden.